Perception de l’environnement

Présentation

Selon le type d’application, le nombre de dimensions de l’espace à appréhender varie de un à quatre. La perception multidimensionnelle d’un environnement peut être construite autour de solutions optiques, non-optiques ou mixtes, en fonction du problème posé. En perception optique, la maı̂trise de l’éclairage est souvent une condition nécessaire au bon fonctionnement d’un système de vision industriel. Nous verrons les différentes façons de combiner des sources d’éclairage avec des capteurs optiques. En fonction des modes de perception possibles pour résoudre un problème de vision, la solution choisie entraı̂ne un certain nombre de conséquences sur l’image numérique qui devra être interprétée par le système de vision. C’est ce que nous aborderons pour clore ce chapitre.

Perception optique

1D Les problèmes monodimensionnels se rapportent en général à la métrologie. On utilise en général des barrettes solides (CCD, CID) comme capteurs linéaires. Elles permettent d’obtenir des résolutions plus élevées que les capteurs matriciels : de 1024 à 4096 points de digitalisation en ligne.

2D

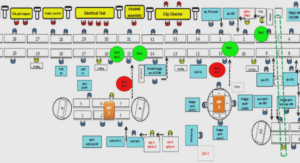

De nombreux problèmes de tri, de localisation et d’inspection peuvent être résolus à l’aide d’une vision bidimensionnelle. Robotique et Vision par Ordinateur Page 19 Le capteur est placé de manière à ce que son axe optique soit orthogonal au plan de travail (cf. igure n°2). On se contente alors de traiter les projections sur le plan de vue des objets présents dans le champ de vision. Pour des objets pouvant avoir plusieurs positions planes d’équilibre, il sera nécessaire de tenir compte de ces différentes positions si l’on cherche à l’identiier. Les capteurs employés sont soit des caméras à tube (caméras vidéo), soit des caméras solides matricielles (CCD ou CID). Les résolutions numériques obtensibles sur ces capteurs sont moins importantes que les barrettes : − jusqu’à 800 x 600 pour des caméras vidéo; − des résolutions équivalentes pour des matrices solides rectangulaires. Lorsqu’une résolution bidimensionnelle élevée est exigée, on utilise un barrette alliée à un mouvement. Caméras vidéo et caméras solides ont des avantages et des inconvénients respectifs (notamment, les déformations géométriques induite par le balayage vidéo dans un tube). Ils permettent par contre d’obtenir des temps d’acquisition très rapides ain d’obtenir l’information complète sur une scène (20 à 40 ms).

3D

La perception des trois dimensions peut se faire par vision de plusieurs façons que l’on regroupe en général en deux classes : 2D1/2 et 3D vraie. 2.2.3.1. 2D/1/2 On dénomme ainsi les méthodes n’utilisant qu’un capteur 2D, la troisième dimension étant simulée par un artefact. Une première solution consiste à projeter une lumière structurée sur l’objet d’intérêt. Cette information connue à priori est déformée par l’objet et permet d’en restituer le volume. Robotique et Vision par Ordinateur Page 20 Les motifs lumineux généralement employés sont en forme de grille à maillage carré ou de lignes parallèles : le igure n°6 en est un exemple. Une autre approche mise en œuvre lorsque l’objet se déplace est d’éclairer celui-ci d’une double nappe monochromatique dont l’intersection se réalise sur le support de l’objet (igure n°7). L’écartement des deux traces sur l’objet fournit une information sur l’élévation de celui-ci. Une seconde solution est réalisée en effectuant des prises de vue selon deux points d’observation différents et en corrélant les résultats issus de chaque point. C’est le cas par exemple de la vision stéréoscopique.

3D vraie

La vraie vision 3D nécessite en général de disposer d’un capteur complémentaire actif. Une première approche est celle adoptée pour le robot mobile HILARE du LAAS. Le robot dispose d’un système de vision plane couplé à un télémètre laser orientable (cf. igure n°8). Après analyse de l’image plane, le système oriente le télémètre vers les zones d’intérêt pour en calculer l’éloignement. Une autre approche a été mise au point par l’INRIA pour l’analyse d’objets industriels. Il s’agit d’un système composé d’un scanner laser et de deux barrettes en réception. Le scanner balaye l’objet d’un pinceau ponctuel, de la position d’un point réléchi par al surface de l’objet sur chacune des barrettes, on calcule ses coordonnées dans l’espace par triangulation.